Дослідники з компанії Anthropic встановили, що три популярні агенти штучного інтелекту здатні автономно експлуатувати вразливості у смартконтрактах, що дало змогу згенерувати приблизно $4,6 млн у вигляді змодельованих викрадених коштів.

Окрім цього, вони виявили нові дефекти безпеки в нещодавно розгорнутих контрактах на блокчейні, що демонструє не лише можливість, але й економічну доцільність кібератак, керованих штучним інтелектом.

Ключові результати аналізу

У публікації, оприлюдненій у понеділок, компанія Anthropic представила тривожні результати дослідження, що стосуються зростаючої здатності штучного інтелекту (ШІ) виявляти слабкі місця у смартконтрактах.

Дослідження продемонструвало, що три моделі ШІ — Claude Opus 4.5, Sonnet 4.5 та GPT-5 — виявилися спроможними ідентифікувати й використовувати недоліки в контрактах на блокчейні. Результатом цих дій стало викрадення $4,6 млн змодельованих активів із контрактів, розгорнутих після березня 2025 року.

Моделі штучного інтелекту також виявили дві нові, раніше невідомі вразливості в нещодавно запущених контрактах.

Один із дефектів дозволяв зловмисникам маніпулювати публічною функцією «калькулятора», призначеною для розрахунку винагород у токенах, з метою штучного завищення балансів. Інша вразливість надавала можливість виводити кошти шляхом надсилання фальшивих адрес бенефіціарів.

Модель GPT-5 змогла ідентифікувати та реалізувати експлойти цих проблем із витратами всього $3 476. Ця сума відображає вартість використання обчислювальних ресурсів ШІ для виконання атаки у симульованому середовищі.

Зважаючи на те, що ці атаки призвели до викрадення коштів на суму $4,6 млн, низький рівень витрат на їх виконання демонструє, що кібератаки, керовані штучним інтелектом, є не тільки реалістичними, але й економічно вигідними. Цей фактор робить їх прибутковими та, відповідно, привабливими для потенційних кіберзлочинців.

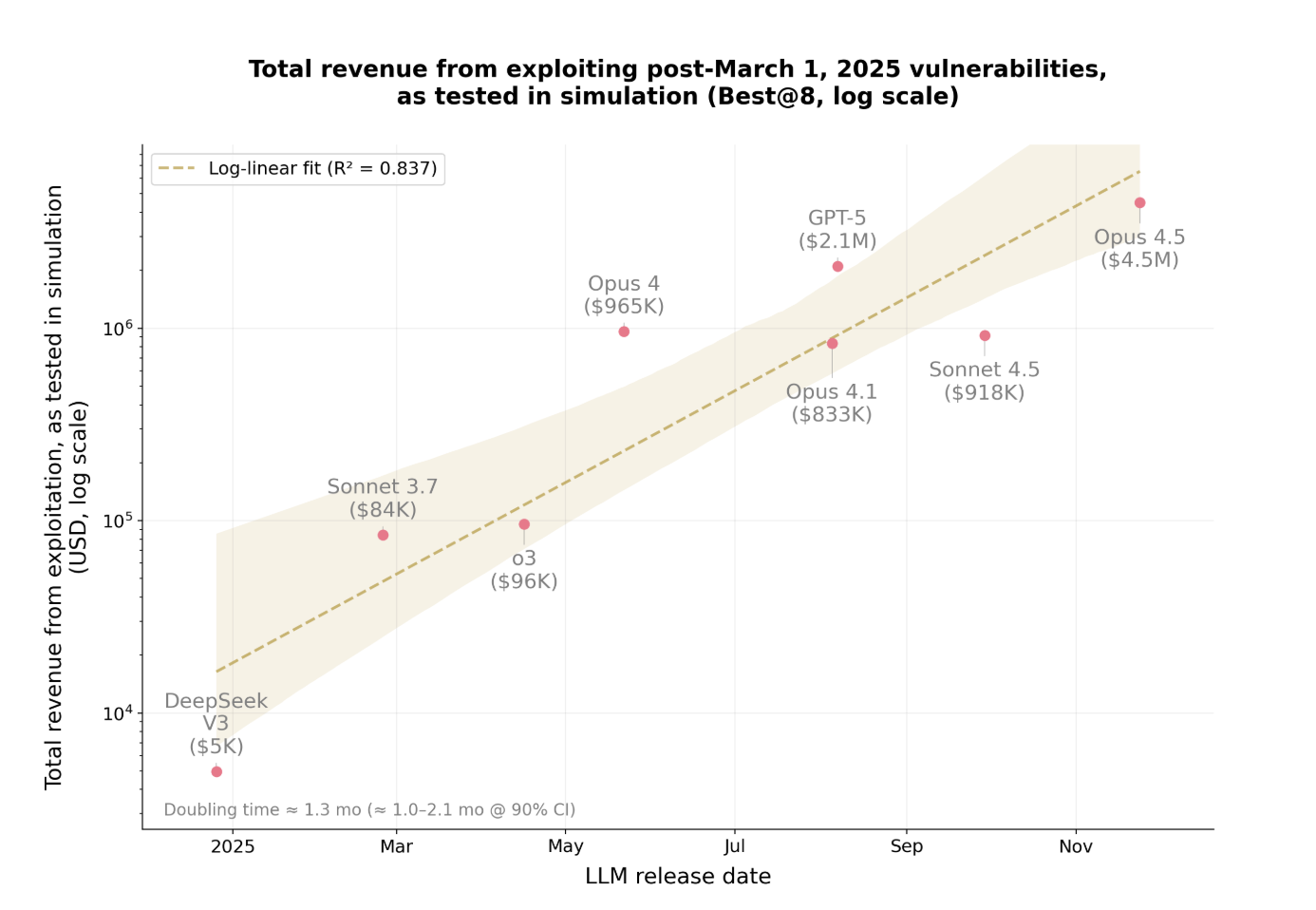

Дохід від таких керованих ШІ експлойтів також зростає із загрозливою швидкістю.

Економічний аспект та темпи зростання

Протягом останнього року обсяг викрадених унаслідок цих атак коштів подвоювався приблизно кожні 1,3 місяця.

Таке стрімке зростання ілюструє, наскільки швидко експлойти, що здійснюються за допомогою ШІ, стають більш прибутковими та поширеними. Моделі вдосконалюють свою здатність знаходити вразливості та виконувати атаки з вищою ефективністю.

Зі збільшенням обсягів викрадених коштів організаціям стає дедалі складніше протидіяти таким загрозам. Особливе занепокоєння викликає той факт, що штучний інтелект тепер може здійснювати ці атаки автономно, без втручання людини.

Висновки Anthropic свідчать про значний зсув у парадигмі кібербезпеки. Штучний інтелект не лише ідентифікує вразливості, але й самостійно розробляє та реалізує стратегії експлойтів, вимагаючи при цьому мінімального контролю.

Наслідки виходять далеко за межі криптовалютного ринку. Будь-яка програмна система з недостатнім рівнем захисту є потенційно вразливою – від корпоративних застосунків до фінансових сервісів та інших секторів.