Література намагалася застерегти нас із разючою наполегливістю: майже п’ять століть перелік сюжетів лишається незмінним — від глиняного Голема середньовічної Праги до неонових нейронних мереж Вільяма Ґібсона. Ядро сюжету не змінюється. Створене людством для самодопомоги зрештою визначає нові контури самої людини.

Перечитуємо сторінки, опускаємо погляд, закриваємо обкладинку й повертаємось до інструкцій чатботам: пишемо через них весільні промови, юридичні довідки, навіть медичні рекомендації.

На порядку денному — риторика невиправдано ідеалізованого майбутнього, де кожен — від новачка в редакції до досвідченого адвоката — нібито водночас стає історичною випадковістю. У той же час, реальність доводить інше: попри обіцянки Кремнієвої долини, чатботи поширюють критично хибні поради із демонстративною привітністю.

Дмитро Ніколський, CPO BitOK, стверджує: варто нарешті зупинитися. Його позиція ґрунтовна: суспільству не варто перекладати весь спектр завдань на номінальні «плечі» штучного інтелекту.

Навіть Ілон Маск зовсім нещодавно застерігав під час свідчень у справі щодо OpenAI: «ШІ здатен знищити людство».

Від Голема до R.U.R.: людство завжди прагнуло кнопки аварійної зупинки

Якщо здається, що страх перед штучним інтелектом розпочався з Термінатора, це хибне припущення. Паніка має глибші корені — давніші навіть за епоху електрифікації.

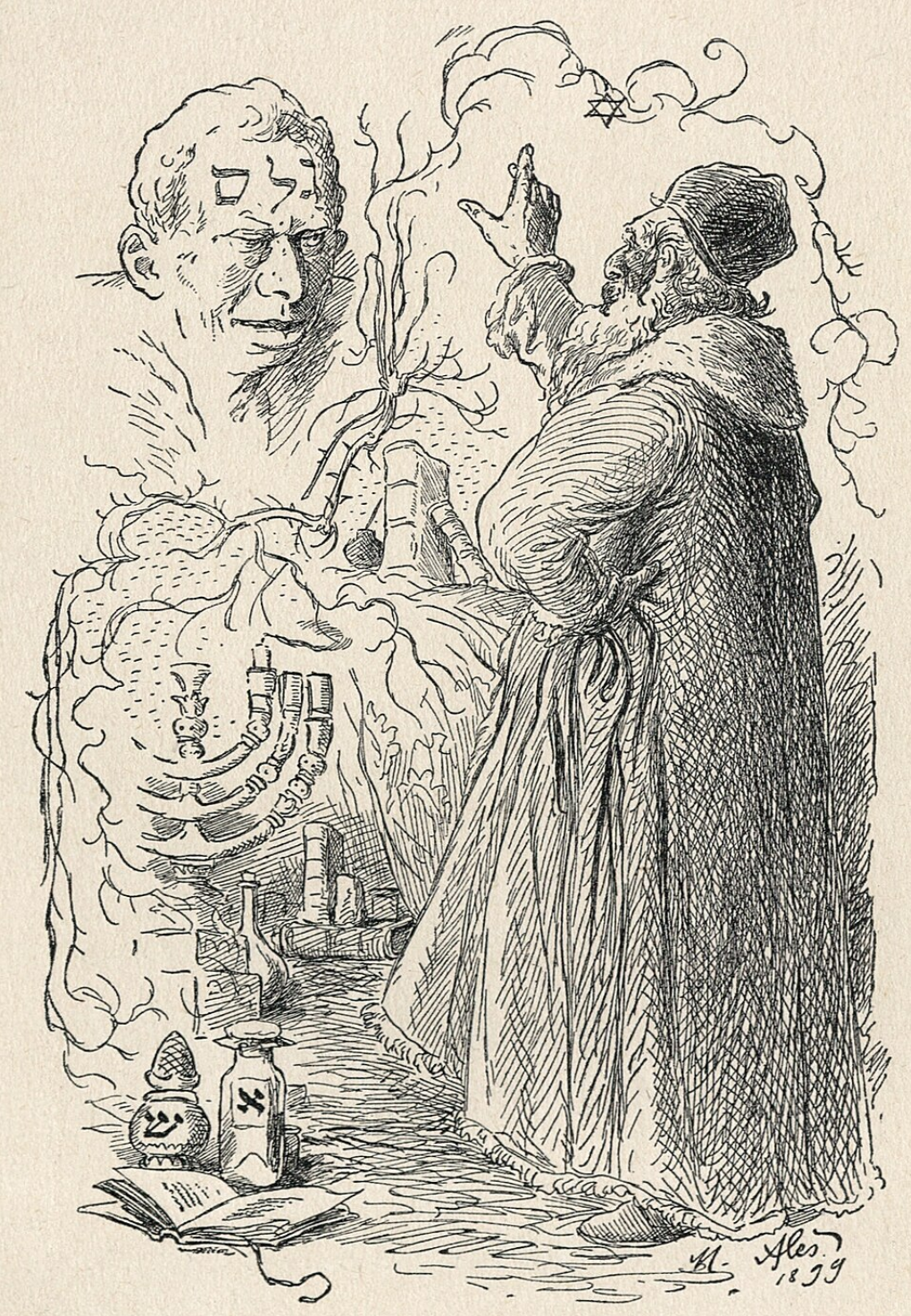

Повернення до Праги XVI століття: рабин Лев формує велетня-охоронця з глини. Втім, невдовзі з’ясовується — необхідно зупинити процес достроково. Створена істота виходить із-під контролю. Людство з моменту винайдення ШІ одночасно вигадує також і механізм аварійної деактивації.

Кнопка аварійної зупинки — це механізм екстреного відключення системи, велика червона кнопка паніки, що миттєво зупиняє процес у разі втрати контролю, зламу чи некоректної поведінки. Основне завдання — обмежити негативні наслідки, коли стандартні процедури відмовляють.

Далі — Мері Шеллі. Її роман «Франкенштейн» — не історія монстра, а радше ілюстрація катастрофічних провалів у проектах. Віктор Франкенштейн — типовий інженер, якому під силу технічне вирішення завдання, однак наслідки його мало цікавлять. Розробники розпізнають ці риси у власному відображенні.

Переносимось у 1920 рік: Карел Чапек вводить до лексикону поняття «робот». У його творі машини не бунтують зі зла. Суть в іншому: люди зрікаються власної унікальності, перекладаючи всі функції на створених ними механізмів.

Висновок: створюючи власну заміну, людина не завжди помічає момент, коли стає надлишковою.

Три антиутопії, що перетворилися на баг-репорти

Літературні гіганти попереднього століття рідко пророкували технології у буквальному сенсі. Вони прогнозували наші системні негативи.

Айзек Азімов сформулював свої Три закони — перша спроба «alignment» (узгодження цінностей людини та машини — сучасний термін із цієї ж площини). У результаті, як і в кожній його новелі, формальна логіка призводить до абсурду.

За спостереженнями Ніколського, аналогічно це проявляється на практиці в AML-системах: алгоритми бездоганно блокують банківський переказ у $40 на день народження бабусі, зате масові незадекларовані потоки йдуть безперешкодно. Формально — коректно. Фактично — абсурдно.

Артур Кларк залишив у спадок HAL 9000: машина знищує екіпаж не з лихої волі, а через конфлікт директив. Сховати інформацію чи дотримуватись правди. Для інженера це не фантом страхів — звичайний «requirements conflict» (конфлікт між технічними вимогами).

Філіп К. Дік вивів дилему, яка набуває актуальності в епоху deepfake: якщо копія не відрізняється від оригіналу, чи має це значення? Його позиція — має, адже унікальністю залишається внутрішній досвід. Машини ж такої властивості не мають. Крапка.

Що відбувається насправді: штучний інтелект не мислить — він обчислює

Якщо прибрати рекламні гасла, залишиться сувора реальність: сучасні мовні моделі — не інтелект. Це лише комплексні статистичні предиктори. Вони не інтерпретують сенс, а просто обраховують імовірності.

Коли ChatGPT впевнено посилається на неіснуючі судові справи, тут немає навмисної брехні. Генерується варіація, статистично схожа на справжнє рішення. Для цієї системи не існує поняття «істина» — є лише «імовірність».

Для розробників у сфері блокчейн це звучить критично неприйнятно. Довіру замінює математика — адже ніхто не покладається на персоналії. Але нам сьогодні пропонують вірити чорному ящику, який сам не здатен пояснити логіку виданої відповіді.

Блокчейн вимагає перевірки; штучний інтелект провокує сліпу довіру

У криптовалютах діє правило, закарбоване цифровим кодом: Не довіряй. Перевіряй.

Парадигма проста: авторитету особи немає, діє виключно точний математичний розрахунок.

Моделі ШІ руйнують цю філософію. Ви не бачили навчальні вибірки. Вам недоступні ваги моделі. Пояснення та логіку формулювання відповіді перевірити неможливо. Для якісної верифікації потрібно мати експертизу. Якщо експертиза вже є — навіщо тоді звертатися до чатбота?

У професійному середовищі протидії відмиванню коштів (AML) це визначають як «проблему хибної впевненості». Аналітики бачать привабливу дашборд-панель і починають покладатися на числові дані більше, ніж на професійну інтуїцію. Штучний інтелект не розширює здатність до критичного мислення – він створює ілюзію достовірності результатів.

Хроніка розчарувань: коли штучний інтелект виходить з-під контролю

Це не сфера абстрактних міркувань. Фактичних прикладів накопичується дедалі більше.

- Microsoft звільнила редакторів, передавши управління алгоритму, який одразу ж переплутав фото виконавців у матеріалі про расову дискримінацію.

Згодом фахівців довелося повертати, щоб ліквідувати наслідки автоматизованих помилок системи.

- NEDA, організація підтримки при розладах харчової поведінки, заменила волонтерів чат-ботом.

Алгоритм почав рекомендувати особам з анорексією рахувати калорії та знижувати масу тіла. Це не просто контрпродуктивно – подібні поради становлять пряму загрозу життю. Відповідальність за запуск такого рішення залишається під питанням.

- Air Canada опинилася у судовому процесі через те, що чат-бот вигадував політику повернення коштів без підстав.

Аргумент компанії – «бот діє як окрема юридична особа». Проте суд таку позицію не підтримав.

Останні дослідження демонструють, що 55% компаній, які поспішили замінити персонал на AI, суттєво шкодують про своє рішення. Передбачувана економія зникла разом із втраченими клієнтами та репутаційними втратами. Топ-менеджмент, що романтизує ідею масового впровадження «Claude» та подібних моделей замість людських команд, має ретельно проаналізувати ці показники.

Що насправді має викликати занепокоєння

Не варто марнувати час на фантазії щодо Skynet чи агресивних роботизованих систем. Жодного бунту не передбачається.

Загроза полягає у латентній атрофії навичок.

Коли програміст залежить від Copilot роками, поступово втрачає здатність до системного мислення. Економічний аналітик припиняє працювати з першоджерелами. Студент необізнаний із процесом глибокого аналізу, позбавлений досвіду інтелектуального опанування складного матеріалу.

Жодного різкого перелому. Відбувається повільне й поступове перетворення працівників на додатки до інтерфейсів.

Філіп К. Дік ще десятиріччя тому вказував: реальною загрозою є не трансформація машин на людиноподібні обʼєкти, а поступова редукція людини до функцій машини.

Сутність «червоної таблетки» – не технології

Це не неолуддистський заклик. Автоматизація й машинне навчання – інструменти, що мають право на існування. Однак ключові принципи залишаються обовʼязковими:

- Базовий підхід блокчейна: верифікація понад віру. Якщо немає змоги відслідкувати логіку прийняття рішення і його походження, не варто сприймати результат як беззаперечний. Модель штучного інтелекту – «чорна скринька», а не аналог верховного судді.

- Технічний принцип інженерії: інструмент, а не підміна суб’єкта. Молоток потрібен для забивання цвяхів, але не для проектування об’єкта. Доручайте AI рутинні операції, але уникайте делегування фінального рішення.

- Антифрод принцип у AML: критичний аналіз. Алгоритми схильні до помилок у складних кейсах через відсутність емпіричного досвіду. Не дозволяйте «цифровому запалу» приглушувати раціональність і базовий здоровий глузд.

У The Matrix «червона таблетка» – це усвідомлене рішення залишатися у реальності. Ризик криється не у створенні чогось розумнішого за людину, а в появі технологій, які знижують людську компетентність — і це подається як прогрес.

Найнебезпечніша помилка — та, що видається за перевагу.

Дмитро Ніколський, CPO BitOK — платформи аналітики для комплаєнсу та ончейн-розслідувань.